…

Yo estaba esperando el análisis hypeante con los a73 y Parker, pero solo veo drama y nintendoomed, pos nada.

Urien especulas con datos de los que no hypean, por que no analizas con los supuestos a73? Y que sea Pascal, creo que es más divertido para la imaginación

No especulo con el A73 de cara a Switch por un motivo muy simple, es un chip que aparecerá bajo un proceso de 10nm y creo que los pocos chips con dicho proceso llevan dicha CPU. En dicho proceso un solo núcleo del Cortex A73 mide unos 0.65mm^2 por lo que es un chip muy pero que muy pequeño pero Nvidia no ha adoptado su tecnología a los 10nm aún y el Tegra más avanzado que es el Tegra Parker se fabrica utilizando los 16FF+ de TSMC y a la hora de fabricar un SoC es necesario que todos y cada uno de los componentes estén adaptados al mismo nodo de fabricación.

Pero hay un tema que es el timing, montar una consola no es como montar un PC en la tienda sino que tiene años de desarrollo de antemano y es muy posible que cuando Nintendo y Nvidia firmaron el acuerdo y empezarón a concretar las piezas de la arquitectura el Cortex A73 no estaba dentro de las posibles CPUs seleccionables. En todo caso si Nvidia ha conseguido convencer a Nintendo para adoptar el proceso de 10nm de Samsung para su consola entonces me callare y mi reacción será la siguiente:

Cuando aparece un nuevo nodo los fabricantes de chips suelen colocar unos precios por oblea muy altos para paliar los costes de transición. Los 10nm son un nodo muy caro en estos momentos y aunque sea posible hacer un chip más pequeño y de menor consumo o capaz de alcanzar mayores velocidades quien pide la fabricacion del chip se puede ¿más barato con el nodo viejo en vez del nodo nuevo. ¿Cuando se empezó Nintendo a plantear lo que acabaría siendo Switch? ¿En 2014? ¿Que tecnología había por aquel entonces que fuese palpable y disponible? Un fabricante de consolas necesita algo que exista fisicamente y se pueda fabricar en masa no en el momento en que se lanza la consola sino en el momento en el que los ingenieros empiezan a trabajar en el nuevo sistema

En cuanto a la diferencia entre Maxwell y Pascal… Bueno, ambas utlilizan núcleos CUDA pero el diseño es compleatamente distinto, la forma en la que las unidades CUDA están organizadas es distinta, en el caso de Maxwell están organizadas en grupos de 128 llamados SMM.

El ratio es de 128 núcleos CUDA para 8 Tex (Unidades de texturas), en el caso de Pascal la organizacion de cada SM es distinta:

Si os fijais en la organizacion de los SMM y los SM veréis que un SM no incluye el planificador (Polymorph Engine), tiene la mitad de unidades CUDA y de texturas y tampoco la cache compartida. Esto tiene una respuesta muy pero que muy sencilla que os va a sorprender y que pone en perspectiva lo que es Pascal realmente.

Esto es el GPC de la GeForce 1080, si os dais cuenta esta compuesto por un grupo de TPC que incluyen en cada uno de ellos 2 SM y si os dais cuenta debajo del segundo SM de cada TPC hay una linea azul claro que es la cache comprtida y el TPC en la parte superior tiene el Polymorph Engine por lo que podemos deducir que TPC en Pascal= SMM en Maxwell y el colmo de todo es que en las mismas condiciones exactas ambos chips rinden igual es que… la gracia es que Pascal es la misma arquitectura que Maxwell pero a 16nm FinFet. Es decir, el «Maxwell» 256 cores del Tegra X1 y el «Pascal» 256 cores del Tegra «Parker» son en realidad la misma GPU pero con nodos de fabricación distintos. Esta maniobra no es diferente que la que ha hecho AMD con Polaris que no es más que GCN adaptada a procesos FinFet (16 y 14nm) y el nodo 16FF+ que utiliza el Tegra «Parker» le permite alcanzar mayores velocidades de reloj pero Nvidia nunca ha hecho oficiales dichas velocidades de reloj y las especificaciones del Tegra «Parker» en concreto sino que ha hablado de la potencia global dentro del Drive PX 2.

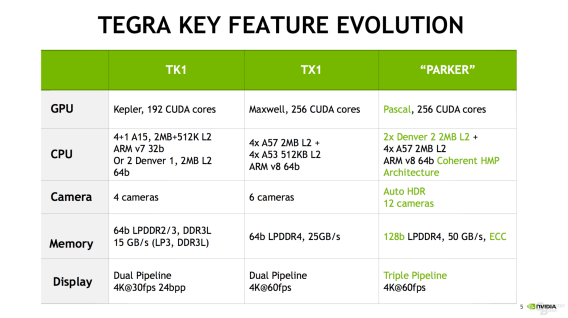

¿Entonces que diferencias hay entre el Tegra Parker y el Tegra X1? La tabla de especificaciones comparativas que siempre pongo nos marcan las diferencias.

La GPU en realidad es la «misma» por lo que tenemos que mirar en otras partes y la diferencia esta en la CPU y el Uncore, la configuracion del Tegra X1 es Cortex A57+Cortex A53 mientras que en el Tegra «Parker» es Cortex A57+Denver 2. En ambas configuraciones el punto en común es el Cortex A57 pero la otra CPU cambia por completo siendo en el X1 un Cortex A53 y en el otro caso Denver 2. A más, a mas, en el caso de «Parker» hay un nuevo uncore llamado Coherent HMP architecture que es el elemento más diferenciador de todos.

Imaginaos por un momento que un SoC es una ciudad con distintos barrios donde cada barrio es un componente y que dentro de dicha ciudad hay una autopista circular. que lo que hace es atravesar toda la ciudad por donde pasan la mayoría de los coches/datos para ir de un barrio a otro e incluso para entrar y salir de la ciudad.

El uncore no es dicha autopista, en realida es el sistema de tráfico que se encarga de gestionar los viajes de los datos y en general suele ser un Crossbar Switch controlado que abre y cierra los canales de datos hacía una direccion o hacía otra. Cuando los datos salen de la CPU, la GPU o incluso vienen de la memoria es el Crossbar Switch el que se encarga de envialos a su destinto. Pues bien, el HMP es dicho elemento y es donde se encuentra conectada no solo las CPUs y si hacemos caso a la siguiente diapositiva el HMP parece estar pensado para albergar la combo Denver 2+ A57 en realidad.

¿Donde esta la GPU? ¿Es que acaso la GPU no es coherente? Aquí tenemos que entrar en uno de los elementos que suelen tener los SoC y es el hecho que las GPUs suelen tener su propio uncore donde no solo esta conectada la GPU sino una serie de chips de apoyo como pueden ser los chips de codificar y descodificar video por ejemplo. Independientemente de si la GPU es un chip aparte o esta dentro de un SoC esta tiene su propio uncore y es aqui donde las diferencias entre Maxwell y Pascal existen, en el tema del acceso coherente a toda la memoria en arquitecturas con memoria unificada. En el caso del Tegra X1 la GPU no tiene un sistema de coherencia con la CPU por lo el espacio de memoria estaba separado en una serie de direcciones de memoria para la CPU y otra serie de direcciones de memoria para la GPU.

Esto lo llamo Nvidia Unified Virtual Memory, no es más que un nombre que le ha puesto Nvidia al hUMA de las arquitecturas HSA, es exactamente lo mismo…

… al menos en apariencia por el hecho que en Maxwell esa unificación de memoria no era a nivel físico sino virtual y ha sido con Pascal que ha pasado a ser física. ¿Que significa esto? Cuando la memoria no es coherente pese a estas unificada lo que acaba ocurriendo es que para pasar de un espacio de memoria a otro hay que realizar copias de datos incluso si se encuentran fisicamente en la misma memoria. ¿Que importancia tiene esto? Pues es clave porque no sabemos como va a querer Nintendo el esquema de memoria de su consola si completamente coherente y unificado o donde la coherencia no este aunque no lo sabremos hasta que tengamos el SDK de la consola y lo comprobemos pero va a ser un buen indicador para saber si la GPU va a ser Maxwell y/o Pascal pero es que ni eso nos va a hacer falta, cuando manden el chip bajo el microscopio lo sabrán y no creo que tarden mucho una vez alguien haga un análisis forense sobre una unidad de la consola y nos saque una litografía pormenorizada del chip principal.

Sin embargo la switch mini/micro sin dock y sin mandos desenganchables probablemente si se fabrique en 10 nm

Me gustaMe gusta

No creo que nintendo se plantee sacar la revisión que nombras a corto plazo, para que eso suceda, Switch tiene que vender mal y haber demanda de un sistema solo portátil y más barato o que tenga éxito y la saquen al final de la vida comercial, pero sigue teniendo que haber demanda, o incluso no existir nunca.

Me intriga la solución que aplique nintendo al problema del ancho de banda de la ram en caso de que la base sea Maxwell, que podría ser más barato y ecológico:

Aumentar el bus de datos

Memoria fuera del SoC

Memoria dentro del SoC

O soldado encima del SoC

Me gustaMe gusta

Bueno, pues descartado el 73 asimilamos que sera el 57, los motivos estan mejor explicados, aunque me gustaria que nintendo de la sorpresa y se hayan rascado el bolsillo

Me gustaMe gusta

ni A73, ni A57,

va a ser A53 t daros con un canto en los dientes

0,5 teraflops de potencia vs wiiU 0,3 teraflops y eso daros con un canto en los dientes

http://www.meristation.com/noticias/son-estas-las-especificaciones-finales-de-switch/2164970

Me gustaLe gusta a 1 persona

Si quieres tener un poco de credibilidad no utilices esa fuente. Menuda troleada de vídeo. Si el jefe es así, no me extraña que el foro esté lleno de trols, y el ambiente tal como está

p.d: Wii U 176 gflops

Me gustaMe gusta

Hola Urian!!

No se, no tengo ni idea de lo que va a sacar Nintendo con esta switch, pero…he visto este vídeo que me ha hecho reflexionar un poco. O sea, es muy muy probable que sea como tú dices, pero…

¿Puede estar jugando Nintendo con nosotros?….. Después del bajón puede venir otro hipe poco antes de la fecha de salida, lo que podría generar más ventas.

Un saludo.

Me gustaMe gusta

Pero si con un arm a15 a 2 ghz ronda la cpu de ps4… Que mas queres para los multis? X-D y le bajarian algo la frecuencia porque al bajarle los graficos respecto a one los efectos que tiren de cpu tambien irian mas desahogados. Ya se que la de one va overclockeada pero incluso así.

Me gustaMe gusta

Un apunte Urian. Huawei ha sacado recientemente al mercado su kirin 960 con cores A73 en un proceso de 16nm Finfet.

No me explico por qué Nvidia usa en Parker y Switch cores A57 teniendo los A15, A17, A72 y A73 que son mucho más eficientes y estoy seguro mucho más pequeños. Algo de luz sobre eso?

Me gustaMe gusta

una cosa… si lo de maxell tiene pinta a REAL y la bateria no dura mas de 3 horas, que es lo qeu se filtro y sabendo el consumo de maxell piinta a REAL esa duracion…

esat nintendo S pinta a una consola portatil peor DE CASA, una cosnola portatil para NO salir de casa.. ahora entiendo proque nintendo saco e anuncio las baterias EXTERNAS para nintendo S!!!

ahora cuadra muchas cosas..

a ver en enero que se diga todo claro YA.. porque pinta a que se va a retrasar la consola pro su tanto RETRASO de anunciarlas y presentarla.. que AUN no la a presentado… que sera el 13 de noviembre su presentacion REAL.. y sale 2 meses despues.. raro raro.. veo eso

Me gustaMe gusta

De donde sacais lo de las 3h? Precisamente con los nuevos kit de desarrollo se había dicho que solo cambiaba la duración de la batería que pasaba de 3h mínimo a 5h (como 3ds más o menos), lo de que dure 3h solo lo he visto en un video de Meristation muy mierda en el que el tipo dice que eso de 5h no le parece porque si, y afirma que dura 3h(enserio lo dice su explicación para desmentirlo es «porque a el no le parece»).

Me gustaMe gusta

Hola yo veo que te llevaras una sorpresa nintendo switch llevara tecnologia pascal a unque te cueste creerlo sera asi. me gustaria que hablaras y recopilaras mejor todo los rumores y no solo los que dejan mal a nintendo switch. 1 el periodista japonés Nishikawa Zenj ha confirmado, por medio del medio nipón 4Gamer, que Switch podría aprovecharse de nuevas arquitecturas 2 Takashi Mochizuki, reputado analista de mercado dice que la resolucion en modo portatil 1080 p. y luego estos ultimos los de laura kate. seguramente el rumor de eurogamer era de un dvkit viejo y no de los nuevos https://juegosadn.eleconomista.es/nintendo-switch-filtrados-detalles-tecnicos-del-hardware-de-nvidia-no-100468/ http://www.nextn.es/2016/12/nintendo-switch-devkit-rendimiento-portatil/ http://universo-nintendo.com.mx/2016/12/26/nintendo-switch-maxwell-pascal/ https://www.google.es/amp/s/areajugones.es/2016/12/24/un-reputado-analista-habla-sobre-la-resolucion-de-nintendo-switch/amp/?client=ms-android-orange-es

Me gustaMe gusta

Segun laure kate dale el dvkit de octubre es mucho mas potente que los de julio. seguramente el analisis y espeficaciones de eurogamer es de julio estoy convencido que sera pascal no solo por estas declaraciones de laura sino tanbien por las Takashi Mochizuki The Wall Street Journal,-switch-serian-mas-potentes-los-anteriores-los-se-basan-los-rumores-potencia/ http://www.nintenderos.com/2016/12/rumor-sobre-la-potencia-de-nintendo-switch-transmision-usb-c-y-mas/

Me gustaMe gusta

Lo pongo bien perdonar .Segun laure kate dale el dvkit de octubre es mucho mas potente que los de julio. seguramente el analisis y espeficaciones de eurogamer es de julio estoy convencido que sera pascal no solo por estas declaraciones de laura sino tanbien por las Takashi Mochizuki http://www.nintenderos.com/2016/12/rumor-sobre-la-potencia-de-nintendo-switch-transmision-usb-c-y-mas/ http://dfxtech.es/wp/los-ultimos-devkit-switch-serian-mas-potentes-los-anteriores-los-se-basan-los-rumores-potencia/

Me gustaMe gusta